1.研究背景

人工智能体现了悖论:一方面承诺科学奇迹、效率和自由,另一方面预示人类的依赖、被动和过时。消费者对人工智能怀有矛盾的感情;他们欣赏人工智能的卓越能力,但同时也担心这种强大技术的阴暗面。消费者对人工智能的信任在很大程度上取决于如何解决关键的伦理问题(如人工智能偏见、网络安全、隐私、价值对齐)。反过来,人工智能产品的广泛采用取决于消费者对这些产品的信任。由于人工智能技术的指数级增长和无处不在的影响,这些伦理挑战变得更加重要和紧迫。

2.人工智能产品的伦理意义

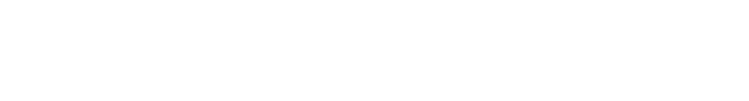

人工智能伦理研究(Bostrom & Yudkowsky, 2014;Wallach & Allen, 2008)和技术的道德意义(Verbeek, 2014)都承认产品特性在影响相关伦理问题方面的重要作用。因此,为了深入研究消费者市场中人工智能的伦理分析,确定了人工智能产品的三个关键维度:多功能、交互性和人工智能阶段。图 1 为人工智能产品的三维分类立方体。

(1)多功能性。多功能是指产品可执行的功能或任务范围。一些人工智能产品如数字个人助理和智能可穿戴设备,可以实现多种功能。多功能人工智能产品依靠各种来源的大数据来训练和调整算法,因此消费者隐私和网络安全问题变得更加突出。此外,多功能人工智能产品可能会导致消费者过度依赖和过度使用产品,产生消费者成瘾等问题,并可能对消费者福利产生负面影响。

(2)交互性。人工智能产品可以与消费者协商,响应消费者的需求,并向消费者解释它正在做什么,以及如何做出决定。交互性高的人工智能产品更有可能面临与隐私、网络安全和消费者自主权/控制权相关的道德挑战。因此,如果消费者过度依赖这些人工智能技术,这些产品可能会对消费者的自主性产生负面影响。不断地获取消费者信息(例如,活动、位置信息、生物特征和偏好),有时在没有消费者同意或知情的情况下,是令人不安的,并可能导致隐私侵犯。此外,通过物联网捕获的消费者数据的连通性使得数据更容易受到恶意攻击和数据泄露,从而引发了网络安全问题。

(3)智能阶段。人工智能产品的智能阶段是指产品中嵌入人工智能水平。不同于多功能和交互性,智能阶段与企业视角关系更密切,与人工智能科学家和工程师更相关。随着人工智能产品的智能阶段越来越高,伦理问题也变得越来越紧迫和复杂。举例来说,人工智能产品的卓越性往往需要更多的消费者数据,这使得隐私和网络安全问题更加突出。并且,一个宏观层面的负面影响是,由于技术的广泛应用,潜在大规模失业。人工智能导致的失业问题可能会在较长时期内出现,需要迫切关注。

3.人工智能产品面临的伦理问题和解决方案

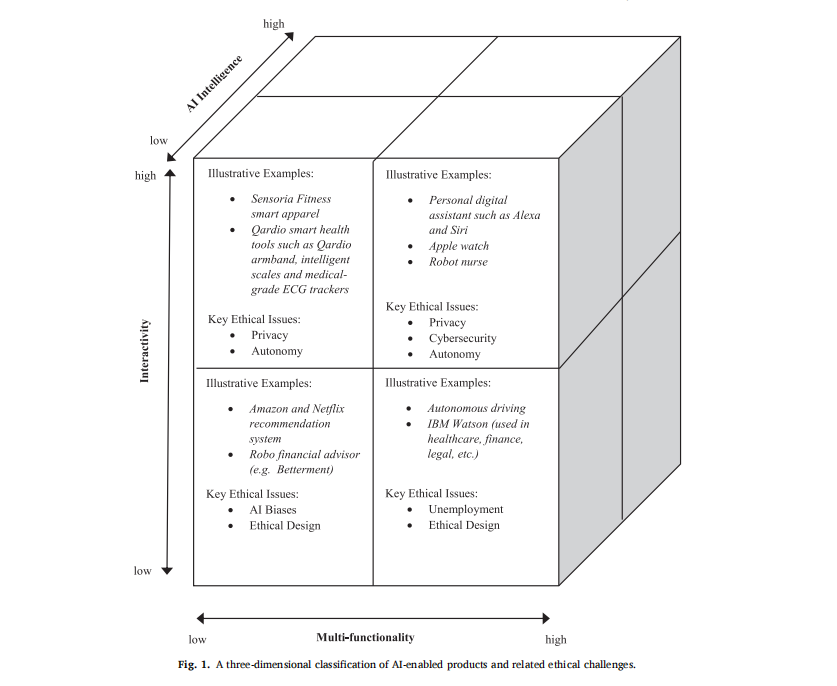

人工智能背景下,一个很重要的方面就是要检查消费者和整个社会是如何受到人工智能技术扩散的影响。本研究采用多层次的视角来分析与人工智能产品相关的伦理问题,分别在产品、消费者和社会这三个层面进行研究,并就公司应该采取什么社会责任行动来解决这些伦理问题提出了想法和建议。

(1)产品层面的伦理问题

在产品层面,由于人工智能产品优越的计算能力和支持产品的自主性,个人决策越来越多地受到技术的调解。例如,消费者申请工作、看电影和寻求医疗服务的决定往往受到人工智能技术的影响(例如,人工智能授权的工作发布、电影推荐和医疗保健诊断)。人工智能产品需要满足某些公平和道德价值一致的原则(安德森和安德森,2011年;博斯特罗姆和尤德科夫斯基,2014年)。我们将讨论产品层面上的两个突出问题:人工智能偏见和伦理设计。

(2)消费者层面的道德问题

在消费者层面上,人工智能技术对大数据的严重依赖给消费者带来了两个道德挑战。人工智能产品显著增加了公司对消费者个人信息的收集、访问和使用(Kaplan &海en,2019),提出了隐私和网络安全问题。在人工智能技术和超互联智能设备的时代,企业负有保护消费者隐私和确保消费者个人数据安全的道德责任(巴罗卡斯和尼森鲍姆,2014;Gwebu,Wang,& Wang,2018)。

(3)社会层面的伦理问题

技术道德意义的社会技术视角强调技术在社会层面的伦理影响(Mi克&福涅尔,1998;Riva et al.,2012;Wallach;& Allen,2008)。在人工智能的背景下,我们确定了两个社会层面的伦理问题,个人自主权和福祉,以及大规模失业。人工智能可能会威胁到个人的自主权,并可能对个人的健康产生“阴暗面”影响。由于人工智能取代工作而导致的失业已经发生,从长远来看将变得更糟,因为人工智能将变得更加智能,拥有更多样化和强大的能力。

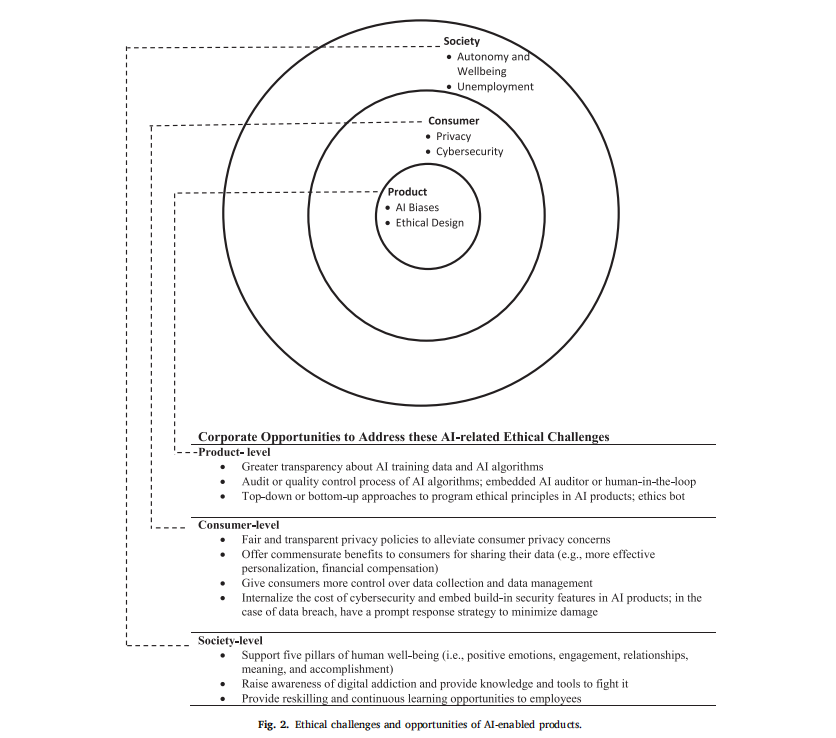

4.人工智能相关的企业社会责任

目前人工智能技术有巨大的潜力同时也存在许多伦理问题,这些伦理问题的解决程度将显著影响消费者对消费者市场中人工智能产品的信任和持续采用。公司应该参与和人工智能相关的社会责任行动,为其人工智能价值创造获得实用和道德的合法性。本文利用利益相关者理论和制度理论来开发一个与人工智能相关的社会责任模型(图 2),该模型可以为寻求通过解决人工智能的伦理问题来建立竞争优势的公司提供指导。

1.人工智能产品的三个维度,多功能、互动性和智能阶段,对各种伦理问题的突出性或重要性有直接影响,因此会影响企业通过企业社会责任行动解决哪些伦理问题的决定。

2.企业的利益相关者关系属性将是其AI相关的企业社会责任政策和实践的关键考虑因素。根据利益相关者理论企业的真正目的是作为协调利益相关者利益的工具,管理层必须平衡多个利益相关者的利益冲突。每个公司在其利益相关者群体的关系属性方面都是独一无二的——权力、合法性和紧迫性——形成不同利益攸关方群体的突出特点,影响平衡利益攸关方诉求的管理优先事项和行动。

组织文化是影响企业AI相关 CSR 的另一个企业特有因素。特别是,企业道德价值观,是组织文化的一个主要方面,可能是企业致力于参与和人工智能相关的 CSR的驱动因素。此外,企业在企业社会责任上的竞争定位也可能对企业AI相关 CSR 的主动性产生一定的影响。

3.政府法规、行业自律、民族文化是人工智能企业社会责任的关键制度环境因素。政府有关信息技术和数据保护的政策和法规,尤其是人工智能技术,将促进人工智能领域的社会责任行为。除了政府法律,行业自律是另一种监管机制,以确保人工智能的伦理和社会责任发展,并通过同行监督和同行压力促进企业社会责任在人工智能领域的参与。文化对人类和企业行为的许多方面产生广泛而深刻的影响,并构成外部制度环境的一个主要方面,之前的研究表明,民族文化影响企业的社会责任,因此,在人工智能领域,国家文化的不同维度如何影响企业的社会责任以及在多大程度上影响企业的社会责任是值得研究的。

通过参与和人工智能相关的企业社会责任,企业可以更好地管理其利益相关者关系,并符合其制度环境,因此,它很可能为其人工智能业务获得务实和道德的合法性,并从增加的利益相关者支持中获益。

5.未来研究启示

未来的研究还应研究解决各种人工智能相关伦理问题的最佳实践的特征。以下是有关产品级伦理问题的研究问题的例子:

减少和消除人工智能偏见以及在使人工智能支持的产品中纳入适当的伦理价值的最有效的方法是什么?公司间联盟、跨部门伙伴关系或开放创新在多大程度上有助于解决这些复杂的道德问题?

公司应该如何准确地衡量其产品中的人工智能偏见的程度,并将人工智能偏见的水平作为产品质量控制的一个关键参数?消费者是否或多或少可能信任并从对人工智能偏见透明的公司/品牌购买?

在什么情况下,一种自上而下或自下而上的方法可以更有效地在人工智能产品中嵌入道德价值?在什么情况下,将这两种方法结合起来的混合方法会更有效?

转发说明

版权说明: 以上内容参考文献,Du S, Xie C. Paradoxes of artificial intelligence in consumer markets: Ethical challenges and opportunities[J]. Journal of Business Research, 2021, 129: 961-974.

免责声明:文章转载仅用于学术交流,版权归原作者和原发刊所有,转载请注明出处。如果我们的行为侵犯了您的权益,请及时联系我们,我们将会妥善处理该部分内容。

文章内容来源:微信公众号中外商学